Menu

0

Menu

- Trang chủ

-

Sản phẩm

- Camera không dây thông minh

- Thiết bị thông minh Ezviz

- Camera có dây, đầu ghi hình

- Camera 4G, Sạc điện năng lượng

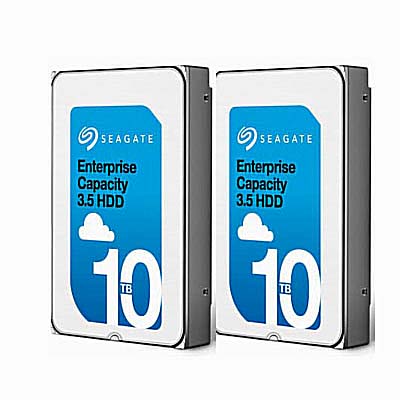

- Ổ cứng , thiết bị lưu trữ

- Cáp mạng, thiết bị mạng

- Báo động, chống đột nhập

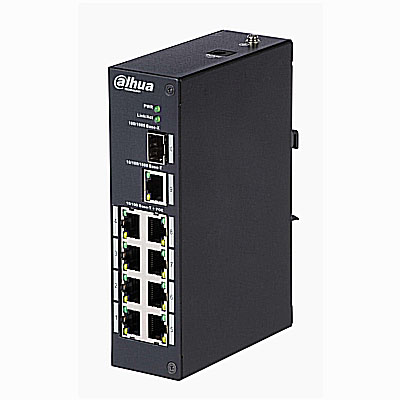

- Switch PoE công nghệ AI

- Máy chấm công bằng khuôn mặt

- Camera hành trình ô tô

- Màn hình di động portable

- Báo khói, báo cháy, báo gas

- Chuông cửa màn hình màu

- Thiết bị tiện ích khác

- Giải pháp công nghệ

- Tin tức

- DownLoad

-

- Đăng nhập

- Đăng ký

- Liên hệ

- Giới thiệu DNTECH

- Điều khoản sử dụng

.png)

.jpg)

.jpg)

.jpg)

.jpg)